OpenAI GPT-5.2 Duyuruldu: İşte Tüm Yeni Özellikler

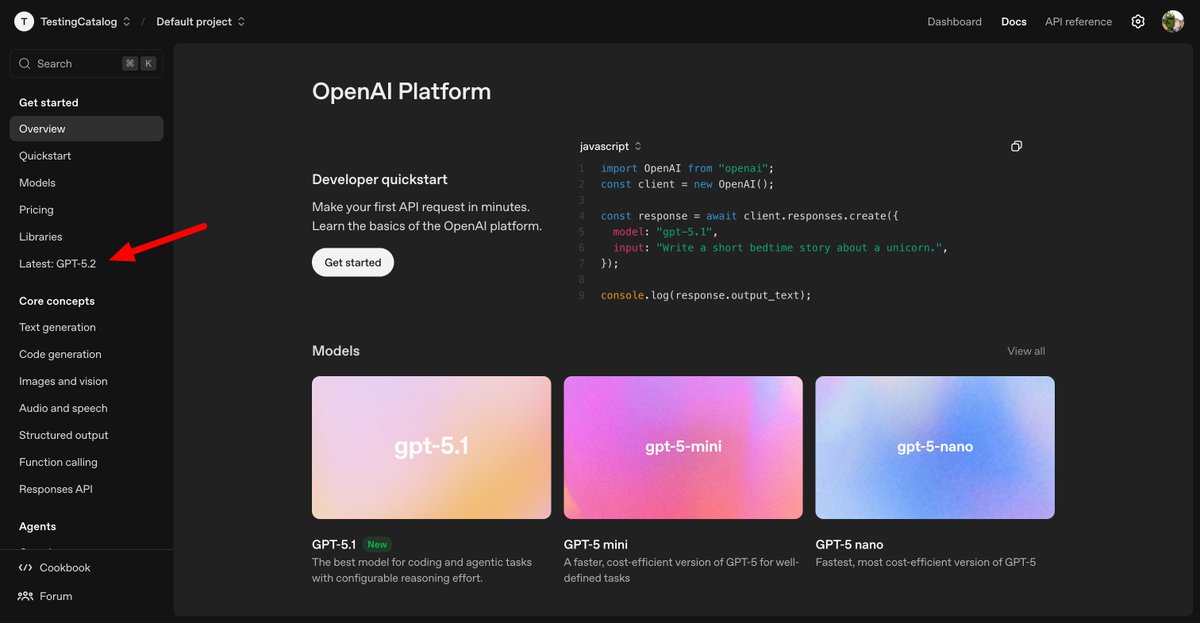

GPT-5.2, OpenAI tarafından geliştirilen ve 11 Aralık 2025 tarihinde genel kullanıma sunulan çok modlu bir büyük dil modelidir. GPT-5 serisinin ikinci büyük ara güncellemesi olan bu model, selefi GPT-5.1'e kıyasla özellikle “muhakeme yeteneği”, işlem hızı ve bağlam anlama kapasitesinde önemli iyileştirmeler içermektedir. Endüstri analistleri tarafından, Google'ın Gemini 3 modelinin yükselişine bir yanıt olarak planlanandan daha erken bir tarihte, "acil durum" (code red) protokolü kapsamında piyasaya sürüldüğü iddia edilmektedir.

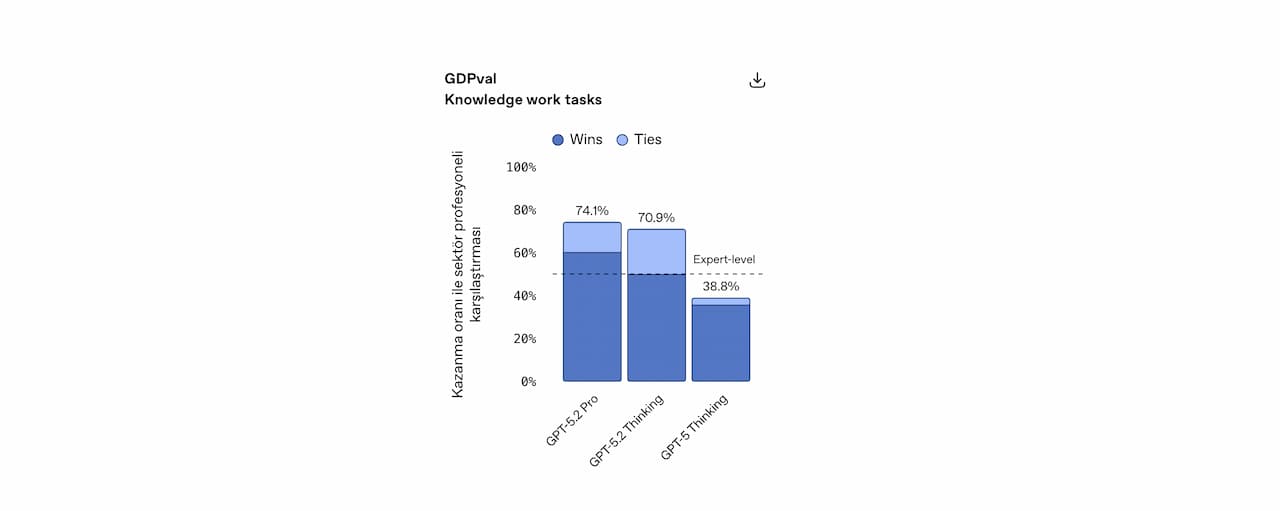

Model, tek bir yapı yerine Instant, Thinking ve Pro olmak üzere üç farklı varyasyon halinde sunulmuş olup, yapay zeka literatüründe “özelleşmiş genel zeka” döneminin başlangıcı olarak nitelendirilmektedir.

GPT-5 serisinin ilk sürümü 2025 yılının başlarında piyasaya sürülmüş ve yapay zeka yeteneklerinde "System 2" (yavaş ve mantıksal düşünme) entegrasyonu ile dikkat çekmişti. Ancak 2025'in son çeyreğinde Google DeepMind tarafından geliştirilen Gemini 3'ün, özellikle kodlama ve matematiksel problem çözme testlerinde liderliği ele geçirmesi, OpenAI içindeki geliştirme takvimini hızlandırdı.

OpenAI CEO'su Sam Altman, 11 Aralık 2025'teki lansmanda GPT-5.2'yi "sadece daha zeki değil, aynı zamanda ne zaman durup düşünmesi gerektiğini bilen bir model" olarak tanımlamıştır. Modelin eğitimi, Ağustos 2025'e kadar olan internet verileri, akademik makaleler ve lisanslı özel veri setleri kullanılarak, şirketin yeni nesil süper bilgisayar kümeleri üzerinde tamamlanmıştır.

GPT-5.2 ile Gelen Temel Teknik Yenilikler Nelerdir?

GPT-5.2, sadece parametre sayısının artırıldığı bir güncelleme değil, modelin "nasıl düşündüğü" ve "veriyi nasıl işlediği" konusunda mimari bir paradigma değişimidir. GPT-5.2 ile gelen yeni özellikler şu şekildedir:

1.Dinamik "Uzmanlar Karışımı"

GPT-4 serisinde tanıtılan MoE mimarisi, GPT-5.2 ile çok daha granüler ve dinamik bir yapıya bürünmüştür.

- Nedir? Modelin tamamı her soruda çalışmaz. Bunun yerine, soruya bağlı olarak sadece ilgili "uzman" sinir ağları devreye girer.

- Yenilik: GPT-5.2, "Adaptive Computation Time" (Uyarlanabilir Hesaplama Süresi) adı verilen bir teknik kullanır. Model, sorunun zorluğunu analiz eder ve basit bir "Merhaba" için çok az kaynak tüketirken, karmaşık bir kuantum fiziği sorusu için işlem gücünü dinamik olarak artırır. "Instant" ve "Pro" modelleri arasındaki farkı yaratan temel mimari budur.

2.Örtük Muhakeme Zinciri

Bu, GPT-5.2'nin "Thinking" varyasyonunun kalbidir. Önceki modellerde "Adım adım düşün" komutunun kullanıcının vermesi gerekirken, bu modelde süreç otomatize edilmiş ve derinleştirilmiştir.

- Süreç: Model, kullanıcıya yanıt vermeden önce “gizli katmanlarda” bir iç monolog yürütür. Problemi parçalara böler, kendi mantığını test eder ve hatalı yolları eler.

- Teknik Fark: Bu düşünme süreci token maliyetine dahil olsa da, son kullanıcıya yansıyan çıktı sadece rafine edilmiş sonuçtur. Bu teknik, matematiksel hataları ve mantık boşluklarını %60-70 oranında azaltmıştır.

3. Omni-Native (Doğuştan Çok Modlu) Mimari

GPT-4o ile başlayan bu yaklaşım, GPT-5.2 ile olgunlaşmıştır.

- Eski Yöntem: Eskiden ses için ayrı, görme için ayrı, metin için ayrı modeller birleştirilirdi (Frankenstein yöntemi). Bu, veri kaybına ve gecikmeye yol açardı.

- Yenilik: GPT-5.2, ses dalgalarını, piksel gruplarını ve metin tokenlarını aynı gömme uzayında işler. Bu sayede model, bir videodaki kişinin ses tonundaki sarkazmı anlayıp, bunu yüz ifadesiyle eşleştirerek metin çıktısına doğru duygu durumunu yansıtabilir.

4. Sürekli Öğrenme ve "Bellek Yamaları"

Büyük Dil Modellerinin en büyük sorunu, eğitim bittikten sonra bilgilerin donmasıdır. GPT-5.2, tam bir yeniden eğitime gerek kalmadan bilgilerin güncellenmesine olanak tanıyan yeni bir katman içerir.

- Teknik: Modelin ağırlıklarını tamamen değiştirmek yerine, üzerine ince "bilgi yamaları" eklenebilmektedir. Bu sayede 11 Aralık'ta çıkan bir model, 12 Aralık'taki büyük bir haberi, modeli baştan aşağı eğitmeden öğrenebilir.

5. Yüksek Sıkıştırmalı Bağlam

400.000 tokenlık bağlam penceresini verimli kullanmak için geliştirilen yeni bir dikkat mekanizmasıdır.

- Sorun: Bağlam uzadıkça modelin odaklanma yeteneği düşer ve işlem maliyeti karesel olarak artar.

- Çözüm: GPT-5.2, geçmiş konuşmaları veya yüklenen belgeleri "anlamsal özet vektörleri" olarak sıkıştırır. Bu, modelin yüzlerce sayfa önceki küçük bir detayı, sanki bir cümle önce söylenmiş gibi net hatırlamasını sağlar.

GPT-4 ve GPT-5 ile Karşılaştırmalı Analiz

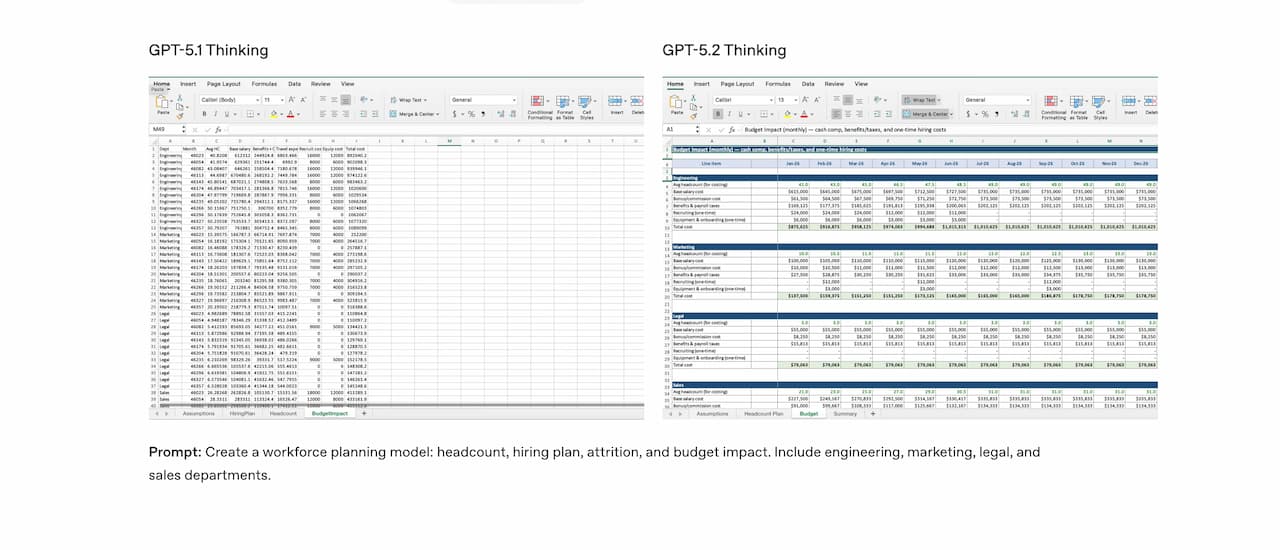

GPT-4 ile GPT-5.2 arasındaki en temel fark, modelin sadece veri işleme kapasitesinde değil, "bilişsel mimarisinde" gerçekleşen devrimsel değişimdir. GPT-4, büyük ölçüde bir sonraki kelimeyi istatistiksel olarak tahmin eden hızlı bir asistan gibi çalışırken; GPT-5.2, özellikle "Thinking" varyasyonuyla yanıt vermeden önce durup düşünen, mantıksal tutarlılığı denetleyen ve karmaşık problemleri parçalara ayırarak çözen bir uzman gibi hareket eder. Bu yapısal değişim, bağlam penceresinin 400.000 tokena çıkarılmasıyla birleşerek, modelin halüsinasyon oranını ciddi ölçüde düşürmüş ve onu basit kod parçaları yazan bir yardımcıdan, karmaşık yazılım projelerini baştan sona yürütebilen otonom bir mühendis seviyesine taşımıştır.

| Özellik | GPT-4o | GPT-5.2 |

|---|---|---|

| Temel Yetenek | Hızlı, çok modlu sohbet botu | Otonom problem çözücü & Ajan (Agent) |

| Bağlam Penceresi | 128.000 Token (~100k kelime) | 400.000 Token (~300k kelime) |

| Maksimum Çıktı (Output) | 4.096 Token (Sınırlı kod üretimi) | 128.000 Token (Tam uygulama yazabilir) |

| Kodlama Başarısı (SWE-bench) | %30 civarı (Verified) | %80 civarı / %55.6 (Pro) |

| Matematik (AIME 2025) | %71 Başarı | %100 Başarı (Thinking Modu ile) |

| Mimari Yapı | Statik MoE (Uzmanlar Karışımı) | Dinamik MoE + Latent CoT (Örtük Muhakeme) |

| Çok Modluluk | Omni (Görsel/Ses Native ama sınırlı) | Omni-Native (Tam kayıpsız füzyon) |

| Bilgi Kesim Tarihi | Ekim 2023 | Ağustos 2025 |

- Kodlama Devrimi: Tabloda görülen en dramatik artış Kodlama alanındadır. Eski model sadece kod parçacıkları (snippet) yazabilirken, GPT-5.2 GitHub'daki gerçek dünya yazılım sorunlarını çözmede %80 barajını aşarak otonom bir yazılım mühendisi seviyesine ulaşmıştır.

- Türkçe Hakimiyeti: "Türkçe Dil Desteği" sadece gramer doğruluğu değil, kültürel bağlamı anlama (örneğin; "Etekleri zil çaldı" deyimini kelime kelime değil, sevinç ifadesi olarak anlama) konusunda GPT-5.2 yerel bir konuşmacı seviyesine gelmiştir.

- Matematik ve Bilim: GPT-4o'nun zorlandığı çok aşamalı fizik ve matematik problemlerinde, GPT-5.2'nin "Thinking" modu neredeyse hatasız bir performans sergilemektedir.

GPT-5.2 Sektörel Etkiler ve Kullanım

Bu model ile yapay zeka "yardımcı" olmaktan çıkıp işi yapan "ajan" konumuna geçmiştir.

- Yazılımcılar İçin: Artık sadece kod tamamlamıyor; eski bir projeyi alıp baştan aşağı modernize edebiliyor. (GitHub sorunlarını çözme oranı %80+).

- İçerik Üreticileri İçin: 400.000 token hafıza sayesinde markanızın 5 yıllık geçmişini yükleyebilirsiniz; ton kayması yaşamadan kitap bile yazar.

- Eğitimciler İçin: Sadece cevabı vermez; öğrencinin nerede mantık hatası yaptığını bulup bir hoca gibi açıklar.

- Neler Yapılabilir?

- Sözleşme Analizi: Kira kontratını yükle, aleyhine olan "tuzak" maddeleri saniyede bulsun.

- Şirket Raporları: Son 10 yılın bilançolarını yükle, "Hangi çeyrekte neden zarar ettik?" diye sor.

Google Gemini 3 ile kızışan rekabet ortamında "acil durum" koduyla piyasaya sürülen bu model; getirdiği "Thinking" modu, 400.000 tokenlık devasa bağlam hafızası ve Omni-Native (Doğuştan Çok Modlu) mimarisiyle, yapay zekayı yalnızca komutları uygulayan pasif bir "asistan" olmaktan çıkarıp, karmaşık süreçleri baştan sona planlayıp yönetebilen otonom bir "ajan" seviyesine yükseltmiştir.

Özellikle halüsinasyon oranlarındaki radikal düşüş ve matematiksel/yazılımsal problemlerde insan uzmanları geride bırakan muhakeme becerisi, GPT-5.2'yi sadece bir iş aracı olmanın ötesine taşıyarak, Yapay Genel Zeka'ya (AGI) giden yolda insanlığın bugüne kadar attığı en somut ve en güçlü adım haline getirmiştir.

Yorumlar (0)

Yorum yapmak için giriş yapmalısınız.

Giriş Yap